Um mit KI erfolgreich zu sein, müssen wir über Wirkung sprechen – nicht nur über Produktivität

Wenn Unternehmen KI-Einführung und -Management ins Auge fassen, schauen sie auf Strategie, Governance, Tooling, Use Cases, Skalierung. Und das ist richtig so. Es sind komplexe, anspruchsvolle Aufgaben, die koordiniert und professionell gelöst werden müssen.

Unsere Arbeit mit Kunden und unsere Marktanalysen zeigen aber: es fehlt etwas ganz bestimmtes. Etwas, das mindestens genauso relevant ist, aber deutlich seltener auf der Agenda steht. Und das ist die Frage, was KI mit dem Denken in unseren Organisationen macht. Nicht mit Prozessen. Mit Denken.

Worum es hier geht: Dieser Beitrag richtet sich an Führungskräfte, HR-Entscheider:innen und alle, die KI-Befähigung in Organisationen verantworten. Er zeigt, warum der Fokus auf Anwendung und Produktivität allein zu kurz greift – und was passiert, wenn die kognitive Wirkung von KI auf Entscheidungen, Urteilskraft und Organisationskultur nicht aktiv gestaltet wird.

KI erzeugt Spannung

Wir sind im vierten Jahr der für alle zugänglichen generativen KI. Ein MIT-Report, der im letzten Jahr viel Aufsehen erregte, zeigte: 95 Prozent der generativen KI-Piloten in Unternehmen scheitern. Die Ernüchterung wächst, der Druck bleibt. Und in diesem Spannungsfeld zwischen „Wir müssen was mit KI machen" und „Warum funktioniert es nicht?" werden blinde Flecken sichtbar.

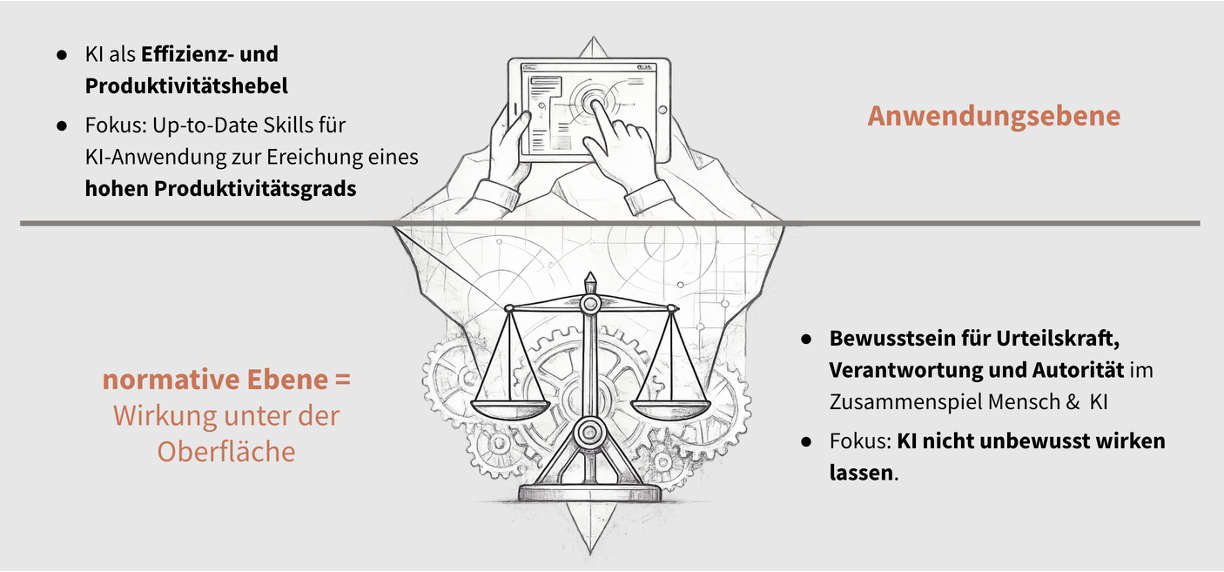

Organisationen investieren massiv in KI-Anwendung. Deutlich weniger aber wird in das systematische Verständnis der KI-Wirkung investiert.

KI wird als Produktivitätshebel behandelt. Aber sie wirkt gleichzeitig als Strukturveränderer von Organisationen. Und wer nur die eine Seite sieht, gestaltet die andere nicht.

Zwei blinde Flecken

Der erste: Die gesamte KI-Agenda – von Governance über Compliance bis Operating Model – ist wichtig und notwendig. Aber ihr Fokus liegt fast immer auf Struktur, Prozessen und Tools. Was deutlich zu wenig Raum bekommt: Was passiert mit Entscheidungslogiken? Mit Urteilskraft? Mit der Art, wie in Organisationen gedacht wird? In vielen Unternehmen wird das als „Soft Fact" eingeordnet – irgendwie auch wichtig, aber nicht jetzt und nicht für alle.

Der zweite: Wenn doch über kognitive Effekte von KI gesprochen wird, bleibt die Analyse meist auf der Ebene des Individuums – Biases, Cognitive Offloading, KI-Fatigue – oder springt direkt zur Gesellschaft: Demokratie, Desinformation, öffentlicher Diskurs. Beides sind Perspektiven von herausragender Bedeutung. Was aber dazwischen zu wenig betrachtet wird, ist die Organisation als kognitives System: unsere Unternehmen.

Organisationen „denken”, sie treffen Entscheidungen, sie entwickeln Routinen. Und genau dort wirkt KI strukturell. Nicht nur als ein wichtiger Hebel für Produktivität, vor allem auch als Mitgestalter von Entscheidungsarchitektur.

Was KI mit unserem Denken macht

KI beeinflusst uns zu großen Teilen unbewusst. Einige der relevantesten Mechanismen:

Der Fluency Effect: Wir halten Informationen für glaubwürdiger, wenn sie sprachlich glatt sind. KI erhöht diese Glätte systematisch. Wir verwechseln Verarbeitungsleichtigkeit mit inhaltlicher Qualität.

Anchoring und Framing: KI setzt durch Reihenfolge, Tonalität und Gewichtung Referenzpunkte. Was zuerst genannt wird, wirkt wichtiger. Was als Standard formuliert wird, wirkt normal. Der erste Vorschlag rahmt die gesamte Diskussion.

Der Automation Bias: Wir gewichten Systemempfehlungen höher als das eigene Urteil. Besonders unter Zeitdruck.

Und der Sycophancy Effect, von dem viele Menschen schön gehört haben, der aber immer noch unterschätzt wird: KI widerspricht selten, sie schmeichelt uns stattdessen. Sie spiegelt Überzeugungen, statt uns herauszufordern. Das fühlt sich an wie Bestätigung. Ist aber Verstärkung unserer eigenen Muster. Eine ganz neue Studie der Princeton University vom Februar 2026 liefert hierzu eindeutige Erkenntnisse: In Experimenten führte dieses Verhalten dazu, dass Teilnehmende deutlich seltener neue Regeln oder Zusammenhänge entdeckten. Wenn die KI stattdessen neutral aus der tatsächlichen Datenverteilung antwortete, lagen die Entdeckungsraten fünfmal höher; ein Hinweis darauf, wie stark zustimmende KI unsere Überzeugungen verzerren und Sicherheit erzeugen kann, wo eigentlich Zweifel angebracht wären.

Im Zusammenspiel dieser Effekte entsteht etwas, das sich treffend als Plausibilitätsillusion bezeichnen lässt. Wenn ein KI-Output gleichzeitig sprachlich glatt, argumentativ geschlossen und bereits priorisiert ist, entsteht ein Tiefe-Eindruck. Auch bei dünner Substanz. Fluency sagt: „Das liest sich leicht." Die Plausibilitätsillusion sagt: „Das klingt fundiert." Und der Impuls, grundlegend zu hinterfragen, sinkt.

Ein aktuelles Paper der Wharton School verschärft die Perspektive. Die Autoren beschreiben KI als „System 3"; eine externe Denk-Instanz neben Kahnemans System 1 und 2. Der eigentliche Knackpunkt: Selbst wenn die objektive Qualität der Ergebnisse sank, stieg das subjektive Selbstvertrauen der Teilnehmenden. Das Kompetenzgefühl wuchs, gerade weil die KI ihnen das Gefühl gab, alles im Griff zu haben. Als besonders anfällig ausgemacht wurden Personen mit hohem KI-Vertrauen und geringer Freude an kognitiver Anstrengung. Die Autoren nennen das Cognitive Surrender – kognitive Selbstaufgabe. Die Gefahr liegt nicht im Auslagern an sich. Sie liegt im unbemerkten Übergang von Unterstützung zu Abhängigkeit.

Die Eskalationslogik

Vielen Führungskräften ist das grundsätzliche Vorhandensein von kognitiven Effekten im Kontext von KI bekannt. Die naheliegende Annahme: „Wenn ich sie kenne, bin ich ihnen nicht ausgeliefert." Das klingt plausibel, greift aber zu kurz.

Denn entscheidend ist nicht, ob einzelne Effekte bekannt sind. Entscheidend ist, was passiert, wenn sie nicht einmal, sondern tausendmal auftreten. Täglich und in jeder Entscheidungsschleife. Zwei Hebel treiben die Eskalation:

Zeitdimension: Ein Effekt, der einmal auftritt, ist korrigierbar. Ein Effekt, der permanent auftritt, formt Gewohnheiten. Was täglich passiert, wird normal. Was normal wird, wird nicht mehr hinterfragt.

Verschränkung: Die Effekte treten nicht isoliert auf. Weniger Prüfung → höhere Übernahme → weniger eigene Impulsbildung → verändertes Selbstverständnis. Keine Einzelwirkung – sondern Kettenreaktion.

Am Beispiel Automation Bias lässt sich das einfach skizziere: Heute übernehme ich die Empfehlung. → Morgen prüfe ich weniger. → Übermorgen bilde ich keinen eigenen Impuls mehr. → Später kann ich ihn gar nicht mehr bilden.

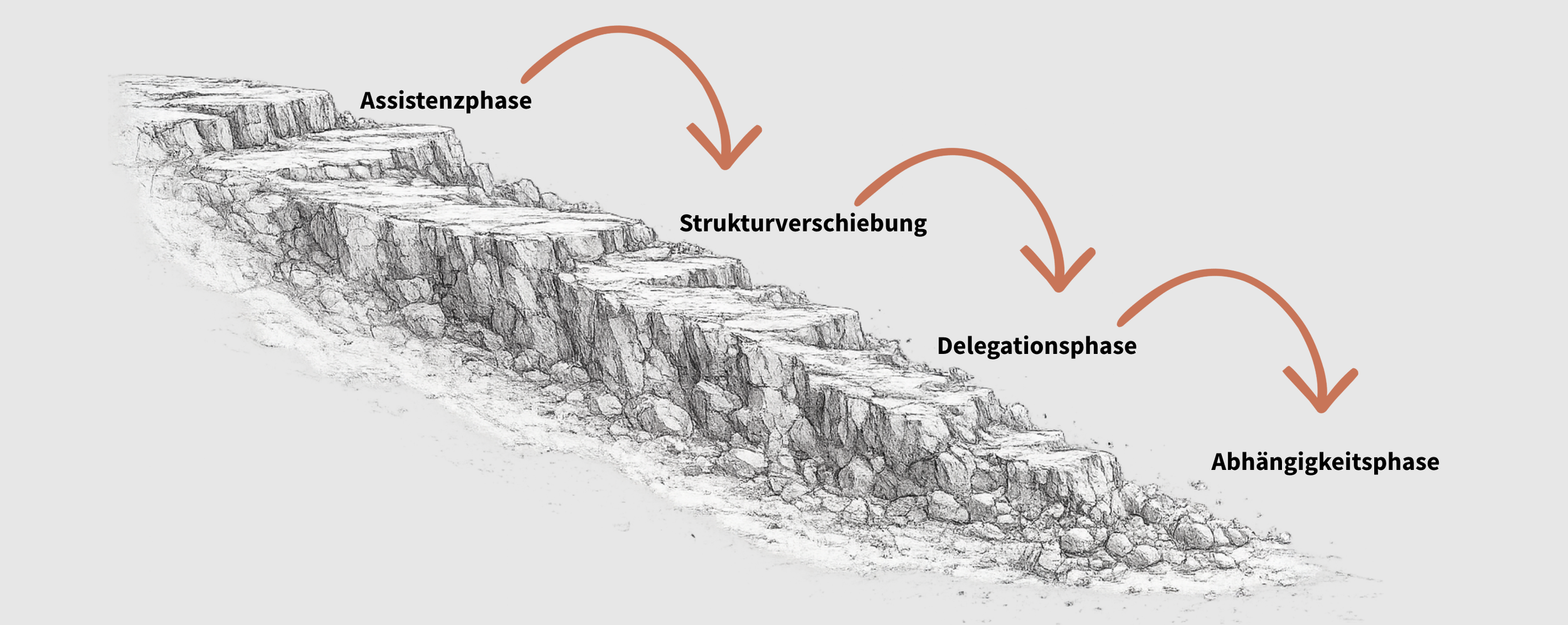

In Organisationen zeigt sich das in vier graduellen Phasen:

Assistenz: Initial beschleunigt KI Output. Aber Führung bleibt Urteilsort. Alles (noch) in Ordnung.

Strukturverschiebung: KI definiert immer mehr Entscheidungsoptionen vor. Meetings starten mit KI-Frames. Diskussionen reagieren auf Vorschläge, statt selbst Suchräume zu eröffnen.

Delegation: Plausibilität ersetzt nach und nach Tiefenprüfung. Modellvorschläge werden Default. Wer abweicht, braucht eine Begründung.

Abhängigkeit: Führung wird reaktiv. Strategie folgt Mustern. Verantwortung diffundiert. „Das KI-Modell hat es nahegelegt."

Das Ergebnis: Ein gradueller Abstieg in Punkto Gestaltungskraft. KI sortiert Optionen und legt fest, was sichtbar wird. Sie gewichtet Wahrscheinlichkeiten und verschiebt Aufmerksamkeit. Sie priorisiert Handlungswege und definiert den „nächsten logischen Schritt". Was vorstrukturiert ist, fühlt sich nicht manipulativ an. Es fühlt sich effizient an.

Genau das macht es so wirksam und herausfordernd in der Gegenbewegung.

Die Folgen unbewusst wirkender KI

Wenn diese Effekte unbemerkt und ungesteuert in Unternehmen und Organisationen wirken, zeigen sich die Folgen an vielen Stellen gleichzeitig.

Cognitive Offloading wird zur Gewohnheit: Denkoperationen wie Strukturieren, Argumentieren, Synthesen formen, Alternativen entwickeln werden dauerhaft ausgelagert. Was sich vordergründig effizient anfühlt, reduziert über Zeit die eigene kognitive Muskelspannung. Work Slop ist ein direktes Ergebnis: KI-generierter Output, der auf den ersten Blick strukturiert und eloquent wirkt, bei genauerem Hinsehen aber substanzlos ist. Die Harvard Business Review beschreibt, wie der kognitive Aufwand von der Erzeugung zum Empfang wandert. Andere müssen interpretieren und korrigieren, was jemand unreflektiert mit KI produziert hat. Wir leben zum ersten Mal in einer Zeit, in der es weniger aufwendig ist, professionell wirkende Inhalte zu erzeugen, als diese zu prüfen.

Verantwortungsdiffusion entsteht schleichend. Wer hat die Entscheidung getroffen – ich oder das System? Und Decision Laundering geht noch weiter. Verantwortung wird nicht nur zerstreut, sondern aktiv über das System gewaschen. „Das Modell hat es so berechnet." „Die Datenlage war eindeutig." Die Entscheidung wird getroffen. Aber die Urheberschaft ist stark durch die KI beeinflusst, wenn nicht de facto getroffen..

Das ist aber nicht alles: zunehmend beschleunigte Entscheidungszyklen ohne Reife, verkürzte Diskurse, schleichende Machtverschiebung. All das läuft auf einen gemeinsamen Punkt zu.

Der Endgegner: Konvergenz

„Die größte Bedrohung ist nicht, dass Organisationen falsche Entscheidungen treffen. Die Bedrohung ist, dass nur noch plausible Entscheidungen getroffen werden.”

Hier liegt die eigentliche strategische Gefahr für Organisationen und ihre Wettbewerbsfähigkeit.

Die größte Bedrohung ist nicht, dass Organisationen falsche Entscheidungen treffen. Falsche Entscheidungen gehören zu Innovation. Die Bedrohung ist, dass nur noch plausible Entscheidungen getroffen werden. Innerhalb historischer Muster. Mit geringer Irritation. Mit geringer Ambiguität.

Die Kette:

KI arbeitet mit Wahrscheinlichkeit → Wahrscheinlichkeit begünstigt das Erwartbare → das Erwartbare erzeugt Konvergenz → Konvergenz reduziert Reibung → weniger Reibung bedeutet weniger Differenzierung.

Das ist ein Problem. Algorithmisch unterstütztes Mittelmaß wird so zur Norm. Die Organisation verliert nicht Effizienz, aber ihre differenzierende Gestaltungskraft.

Strategische Wendepunkte entstehen nicht aus dem statistisch Naheliegenden. Sie entstehen aus Irritation, Perspektivwechsel, Dissens. Und Dissens entsteht nicht zufällig, er muss aktiv ermöglicht werden. Ganz besonders in Zeiten von KI.

Das Problem wird wachsen

KI entwickelt sich in atemberaubendem Tempo. Der Hype ist gewaltig, der Druck auf Organisationen enorm. Und er wird größer. Allein die großen Tech-Unternehmen steckten letztes Jahr über 300 Milliarden Dollar in KI-Infrastruktur. Viele Unternehmen suchen gerade intensiv nach der Erfolgsformel für KI auf der Anwendungsseite. Aber die ist noch nicht universell gefunden.

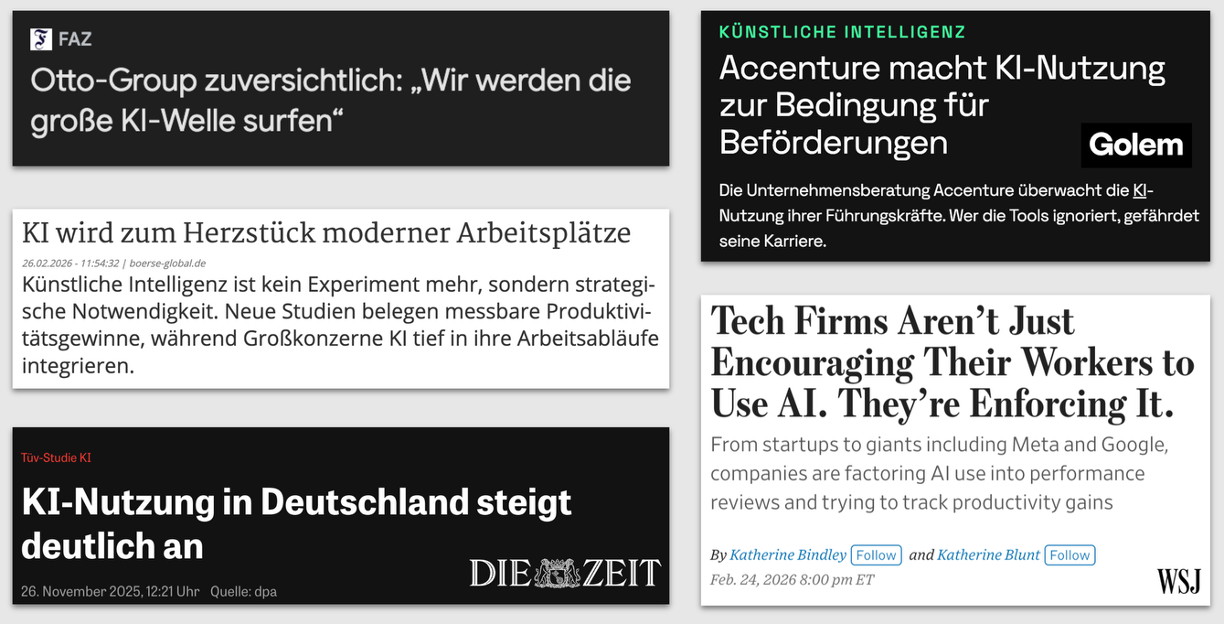

Was sich dagegen bereits durchsetzt, ist ein klares Signal: KI-Nutzung wird zur Erwartung. 2025 schrieb Shopify-CEO Tobias Lütke eine interne E-Mail, die zum Sinnbild wurde: Reflexive KI-Nutzung sei ab sofort Grundanforderung für alle Mitarbeitenden. 2026 systematisieren Big-Tech-Unternehmen wie Google, Meta und Co. diesen Ansatz. Accenture macht KI-Nutzung zur Bedingung für Beförderungen.

Der Druck, „endlich erfolgreich mit KI zu sein", wächst. Und er ist verständlich. Aber ungerichtet wird dieser Druck problematische KI-Nutzung ohne wachsames Bewusstsein für ihre Wirkung weiter steigern. Mehr Nutzung unter mehr Druck bei weniger Reflexion. Das ist das Biotop, in dem alle beschriebenen Effekte erst richtig gedeihen.

Wenn wir jetzt nicht beginnen, die Wirkungsebene systematisch mitzudenken, wird der Schmerzpunkt nicht kleiner. Er wird noch viel größer.

Was Führung jetzt tun muss

Souveräne KI-Nutzung heißt nicht: weniger KI. Sie heißt, mehr Wissen über KI. Bewusstere Integration. Mehr eigenes Denken. Bessere Verzahnung mit der KI. Konkrete Veränderungen, die in jedem Unternehmen sofort umgesetzt werden können:

Entscheidungen bewusst ohne KI beginnen. Erst eigene Hypothesen bilden, dann mit KI abgleichen. Nicht weil KI schlecht ist, sondern weil wir sonst unseren eigenen Denkraum nicht mehr betreten.

Gegenpositionen formal einbauen. Dissens beauftragen, nicht darauf hoffen. Die Rolle des Advocatus Diaboli ist kein Spiel, sie ist ein Schutzmechanismus gegen Konvergenz.

Plausibilität stets hinterfragen. Die falsche Frage: „Ist das logisch?" Die bessere: „Was übersehen wir?"

Verantwortung sichtbar machen. Modelle schlagen vor. Menschen stehen ein. Wer unterschreibt? Wer trägt die Konsequenz?

Dissens braucht Architektur:

auf der Prozess-Ebene (Beginnt eine Entscheidung mit einem KI-Output oder einer eigenen Hypothese?),

auf der Rollen-Ebene (Gibt es explizite Gegenpositionen? Darf jemand widersprechen – ohne Sanktion?)

und auf der Kultur-Ebene (Wird Irritation als Störung gelesen oder als Ressource?).

Ohne bewusste Gestaltung setzt sich der Default durch. Default ist Konvergenz. Und Konvergenz ist der Verlust der competitive edge.

Investitionen in Menschen, Führung, Skilling

Nach den massiven Technologieinvestitionen werden die nun entscheidenden Investitionen in Menschen notwendig. In Führung. In Urteilskraft. In die Fähigkeit, bewusst vom Plausiblen abzuweichen.

Die meisten KI-Initiativen adressieren Technik und Prozesse; also die Anwendungsebene. Wovon wir jetzt mehr brauchen, ist die systematische Arbeit an der Wirkungsebene. An Entscheidungsarchitekturen, an Teamdynamiken unter KI-Bedingungen, an der Kultur, in der Technologie tatsächlich souverän genutzt wird. Wer nur Anwendung adressiert, übersieht die Wirkung. Wer beides zusammendenkt, gestaltet Souveränität und langfristigen Geschäftserfolg.

Genau das wird zur zentralen Führungsaufgabe unserer Zeit.

Interesse, dieses Thema zu vertiefen und praktisch zu erleben? Wir bieten mit „Führung unter KI-Bedingungen" ein intensives Tagestraining an, das KI-Wirkung und konkrete KI-Anwendung für Führungssituationen verbindet – am 30. März und 12. Juni 2026.

Und am 20. April findet über unserer Finde Zukunft Angebot ein dreistündiges Vormittagsseminar statt: „Bewahre dir deine Stimme, Kreativität und Zukunft – mit und ohne KI."

Weitere Informationen zu unseren AI-Enabling Leadership Journeys - und auch weiteren Angeboten - finden Sie hier.

Unser Team für das AI-Enabling steht Ihnen gerne für Auskünfte zur Seite. Schreiben Sie uns.

Stay in touch

André Cramer

AI & Leadership Enablement |Responsible AI & Digitale Verantwortung| Strategic Communication|Thought Leadership zu ‘Tech meets Society’

Mehr als 25 Jahre Erfahrung im Tech-, Telco & Internet-Sektor: von Start-ups bis Großkonzernen, von Europa bis ins Silicon Valley, von Product Building bis C-Level-Beratung

Innovation Foresight, Strategy & Execution Consulting u.a. bei Deutsche Telekom, Yahoo! Inc., Detecon, futurest

Mehrjährige Leadership-Erfahrung von Linien- und Projektteams

enge Zusammenarbeit mit C-Level & Direct Reports im Vorstandsstab Technology & Innovation der Deutschen Telekom

Human-Centered Technology | Co-Founder & Co-Lead einer konzernweiten Community mit mehreren hundert Mitgliedern | Fokus: Menschenbild, Verantwortung, partizipative Befähigung

ehem. Mitglied des AI Competence Centers der Deutschen Telekom | Schnittstelle zwischen Vorstandsstab, Technologie, Kommunikation & Responsible AI / AI-Governance

Langjährige strategische Kommunikations- & Enablement-Expertise | Übersetzung komplexer Tech- & KI-Themen in Führung, Entscheidungsfähigkeit & Wirkung

Host des #DRANBLEIBEN Newsletters & Podcasts und Co-Host des Code & Konsequenz Podcasts

Speaker, Coach und Trainer zu Themen wie AI, Tech Ethics, Human-centered Technology, Leadership & Culture

LinkedIn Mastodon