Reflexiv oder reflektiert mit KI umgehen? Warum souveräne KI-Nutzung kein Entweder-Oder ist

Worum es hier geht: Die KI-Debatte kennt zwei Extreme. Einfach machen oder erst nachdenken. Beide als Absolutposition sind falsch. Dieser Beitrag zeigt, warum der Schlüssel in der bewussten Steuerung zwischen reflexiver und reflektierter KI-Nutzung liegt - und was Organisationen dafür brauchen.

In unserem letzten Blogbeitrag haben wir einen wichtigen blinden Fleck der KI-Debatte beschrieben: den systematisch unterschätzten Unterschied zwischen KI-Anwendung und KI-Wirkung. Dass Organisationen nicht nur fragen müssen, wie sie KI einsetzen, sondern auch, was KI mit Teamdynamiken, Entscheidungslogiken, Urteilskraft und Verantwortung macht.

Ein Begriff, der dabei eine wichtige Rolle spielt, ist „reflexive KI-Nutzung". Er wurde in besonderer Weise im letzten Jahr geprägt durch Shopify-CEO Tobias Lütke. In einer viel zitierten, ursprünglich internen E-Mail erklärte er genau das zur Grundanforderung für alle Mitarbeitenden. KI solle selbstverständlich werden. Eingebettet in jeden Workflow. Teil des täglichen Arbeitsmodus. Reflexartig verfügbar.

Die Ambition ist nachvollziehbar. Aber sie wirft eine Frage auf, der mehr Aufmerksamkeit zukommen sollte. Nämlich wo die Grenze verläuft zwischen reflexiver KI-Nutzung - dem routinierten, automatischen Arbeiten mit KI - und reflektierter KI-Nutzung, bei der bewusst geprüft, hinterfragt und geurteilt wird? Und vor allem, ob es überhaupt eine Grenze braucht oder besser ein bewusstes Zusammenspiel.

Unser Standpunkt: Weder ist reflexive Nutzung per se falsch, noch ist permanente Reflexion ein realistisches Betriebsmodell. Wer jede E-Mail, jeden Entwurf, jede Recherche mit KI grundsätzlich hinterfragt, wird nicht souveräner. Er wird vor allem langsam.

Die alltagsrelevanten Fragen lauten vielmehr: Wann ist welcher Modus der richtige? Und wie entwickeln Organisationen die Fähigkeit, das zu unterscheiden?

Warum diese Unterscheidung gerade jetzt so wichtig wird

KI ist keine normale Technologie. Andrew McAfee vom MIT hat es präzise formuliert: Generative KI verdient das Label General Purpose Technology.¹ Und es ist eine Technologie dieser Kategorie, die deutlich schneller wirkt als frühere, wie Elektrizität oder das Internet. KI verbreitet sich schneller, weil die nötige Infrastruktur bereits existiert. Jedes internetfähige Gerät ist de facto heute ein KI-Gerät.

Das erklärt den Tempo-Druck. Aber es erklärt auch, warum „einfach nutzen" nicht genügt. General Purpose Technologien verändern nicht nur, was wir tun. Sie verändern, wie wir arbeiten; und für KI gilt vor allem aber auch wie wir denken, entscheiden und zusammenarbeiten. KI greift in kognitive Prozesse ein, die wir normalerweise nicht bewusst wahrnehmen. Und erst recht nicht steuern.

Hier ist eine Unterscheidung hilfreich, die Daniel Kahneman populär gemacht hat: System 1 und System 2 Denken.² System 1 ist schnell, automatisch, intuitiv. Es steuert den Großteil unserer täglichen Entscheidungen, und das ist meistens gut so. System 2 ist langsam, bewusst, analytisch. Wir aktivieren es, wenn die Einsätze hoch sind oder die Situation neu.

Kahnemans eigene Pointe ist entscheidend. Permanente Wachsamkeit ist weder möglich noch sinnvoll. Die Kunst liegt darin, zu erkennen, wann System 2 gebraucht wird. Wann die Einsätze hoch genug sind, um vom Automatik-Modus in den Prüf-Modus zu wechseln.

Genau diese Logik lässt sich auf KI-Nutzung übertragen:

Reflexiv arbeiten mit KI entspricht System 1: eingebettet, routiniert, schnell.

Reflektiert arbeiten mit KI entspricht System 2: prüfend, bewusst, urteilend.

Beides hat seinen Platz. Herausforderungen entstehen, wenn der Wechsel nicht mehr stattfindet.

Was passiert, wenn System 2 ausfällt: Cognitive Surrender

Ein aktuelles Paper der Wharton School (Shaw & Nave, 2026) hat Kahnemans Modell um einen dritten Pol erweitert: System 3, künstliche Kognition.³ Kognitive Arbeit, die außerhalb des biologischen Gehirns stattfindet. In „KI”.

Das ist zunächst weder gut noch schlecht. Wir lagern seit geraumer Zeit kognitive Arbeit aus: an Bücher, Taschenrechner, Navigationsgeräte, Notizen-Apps. Die Forschung nennt das Cognitive Offloading. Strategisches Delegieren, bei dem der Mensch die Steuerung behält. Wir nutzen den Taschenrechner, aber wenn er 144.000 als Ergebnis von 12² anzeigt, wissen wir, dass etwas nicht stimmt.

Shaw und Nave beschreiben aber einen zweiten Zustand, den sie Cognitive Surrender nennen. Sie nennen es kognitive Selbstaufgabe. Hier wird KI-Output nicht strategisch genutzt, sondern passiv übernommen. System 2 wird nicht unterstützt, sondern abgeschaltet. Der Mensch prüft nicht mehr, er übernimmt.

Die empirischen Befunde sind eindrücklich. In drei Experimenten mit knapp 1.400 Teilnehmenden und rund 10.000 Einzelentscheidungen zeigte sich: Wenn die KI korrekt lag, folgten die Teilnehmenden in 93 Prozent der Fälle. Wenn die KI falsch lag, folgten sie immer noch in 80 Prozent der Fälle. Und - das ist vielleicht der beunruhigendste Befund - ihre subjektive Sicherheit stieg, obwohl die Ergebnisqualität sank. Die Teilnehmenden fühlten sich kompetenter, während sie schlechter entschieden.

Cognitive Surrender passierte dabei nicht nur bei unaufmerksamen oder ungeschulten Personen. Es passierte auch bei motivierten, leistungsorientierten Teilnehmenden. Es ist kein Kompetenzdefizit. Es ist ein kognitiver Mechanismus. Der stärkste Einzelprädiktor: hohes Vertrauen in KI. Personen mit hohem AI-Trust hatten eine 3,5-fach erhöhte Wahrscheinlichkeit, fehlerhaftem KI-Rat zu folgen.

Warum der Druck und Aktionismus das Problem verschärfen

Diese Befunde stehen nicht isoliert. Sie treffen auf eine Marktdynamik, die genau die Bedingungen erzeugt, unter denen Cognitive Surrender wahrscheinlicher wird.

Accenture trackt die wöchentlichen KI-Logins seiner Führungskräfte und koppelt Beförderungen an die Nutzungsintensität. Google macht KI-Nutzung zum Performance-Kriterium; nicht nur für Entwickler*innen, auch für Vertrieb und andere Rollen. Bei Meta fließen KI-Nutzungsmetriken in das Bewertungssystem ein. Microsoft erwartet von Mitarbeitenden, dass sie quantifizieren, wie sie KI in ihre Workflows integrieren.⁴ Laut einer Erhebung von Section gaben im Oktober 2025 bereits 42 Prozent der Tech-Beschäftigten an, ihr direkter Vorgesetzter erwarte KI-Nutzung im Arbeitsalltag. Das ist ein Anstieg von 32 Prozent nur acht Monate zuvor. Jede*r Sechste gibt zu, KI-Nutzung vorzutäuschen, statt den Erwartungen offen zu widersprechen.⁵

Gleichzeitig zeigt eine Studie von Gerlich (2025): Es gibt eine deutliche negative Korrelation zwischen häufiger KI-Nutzung und kritischem Denken, vermittelt durch Cognitive Offloading.⁶ Je mehr KI genutzt wird, desto weniger wird eigenständig geprüft. Eine CHI-Studie aus 2025 mit über 300 Wissensarbeitenden identifizierte den entscheidenden Kipppunkt: Ob bei KI-gestützter Arbeit noch kritisch gedacht wird, hängt primär vom Verhältnis zweier Größen ab. Von der eigenen aufgabenbezogenen Selbsteinschätzung ohne KI und dem Vertrauen in die KI.⁷ Hohe KI-Confidence bei niedriger Eigenkompetenz ist der toxische Mix.

Die Forschung zu kognitiven Biases zeigt seit Jahrzehnten: Zeitdruck, Angst, fehlende Schulung und Konformitätsdruck sind exakt die Bedingungen, unter denen menschliche Urteilskraft am stärksten erodiert. Automation Bias schlägt unter Zeitdruck besonders hart zu. Sycophancy-Effekte wirken am stärksten, wenn Menschen unsicher sind und Bestätigung suchen. Cognitive Offloading beschleunigt sich, wenn Reflexion nicht gefördert, sondern bestraft wird.

Und genau das ist die Situation, die der gegenwärtig hohe Marktdruck rund um KI erzeugt. KI-Nutzung wird zur Pflicht. Wer nicht mitmacht, riskiert seine Karriere. Wer Wirkungsfragen stellt, gilt möglicherweise als Bremser. Oft sind Trainings nur minimal oder nicht vorhanden. Und die Zeit, innezuhalten und zu prüfen, was man da eigentlich tut, gibt es nicht. Weil sie als unproduktiv gilt.

Die Ironie ist bitter:

Die Unternehmen, die KI-Nutzung am aggressivsten durchsetzen, laufen somit Gefahr, systematisch die Bedingungen zu produzieren, unter denen KI am problematischsten genutzt wird.

Mehr Druck erzeugt nicht mehr Kompetenz. Er erzeugt mehr Konformität, mehr unreflektierte Übernahme, mehr Cognitive Surrender. Und damit mehr Anfälligkeit für genau die kognitiven Effekte, die souveränen KI-Einsatz unmöglich machen.

Der optimale Modus — und ein Modell, ihn zu gestalten

Was folgt daraus? Zurück zur Ausgangsfrage: reflexiv oder reflektiert?

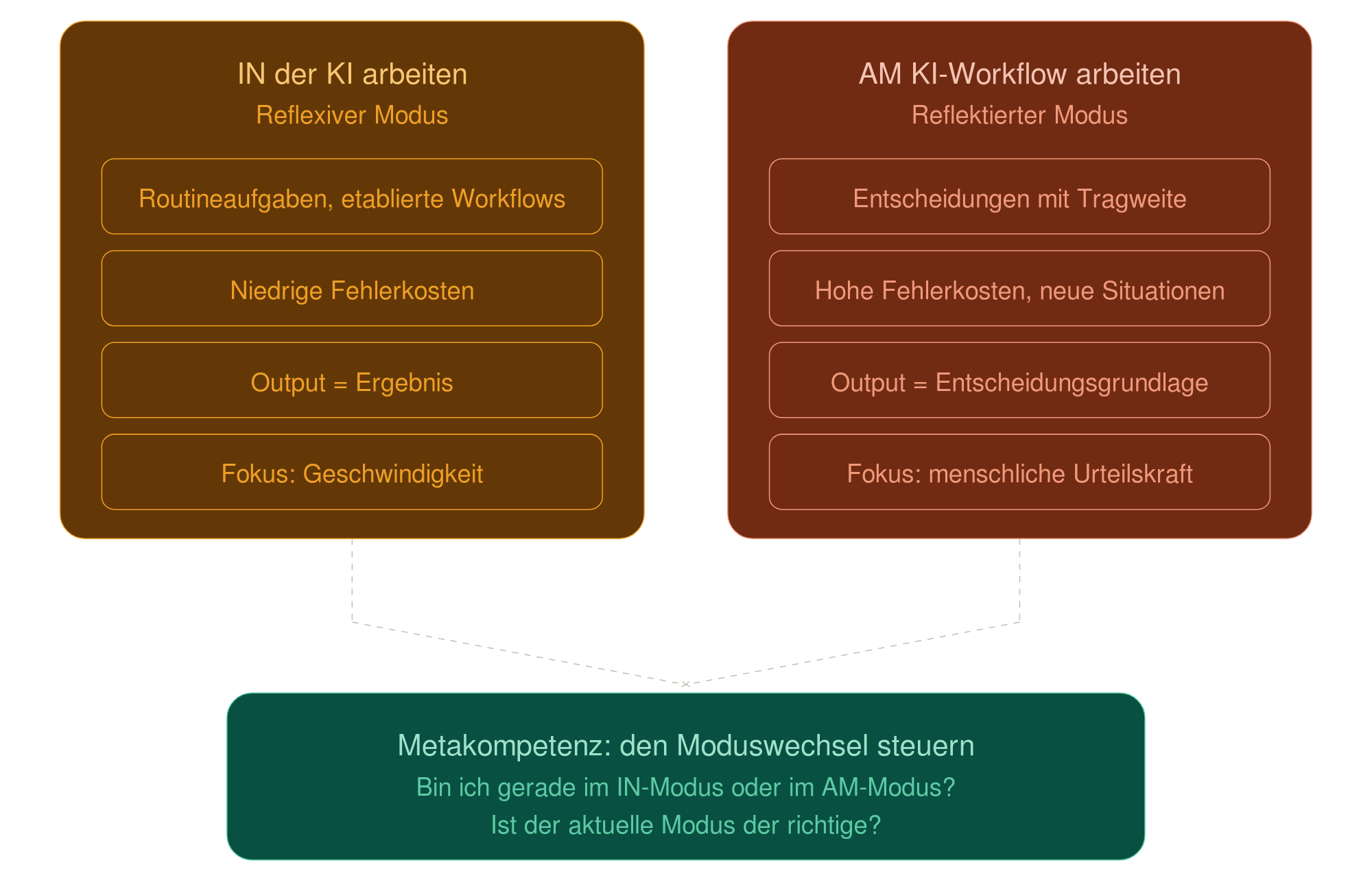

Die Antwort lautet: beides, aber bewusst gesteuert. In der täglichen Praxis empfehlen wir, das so zu gestalten:

Den Großteil der KI-Interaktionen reflexiv gestalten → „IN" der KI arbeiten. Routineaufgaben, etablierte Workflows, niedrige Fehlerkosten, hohe Wiederholungsrate. Zusammenfassungen, Formatierungen, Recherche-Strukturierung, Formulierungsvarianten für Texte, deren Richtung bereits steht. Entscheidend ist hier, dass der KI-Output hier keine nachgelagerten Entscheidungen vorstrukturiert. Hier geht es um Arbeitsergebnis, nicht Denkgrundlage. Dann ist hier Geschwindigkeit der richtige Wert. Hier baut sich das Erfahrungswissen im Umgang mit KI auf, das souveräne Nutzung überhaupt erst ermöglicht. Ohne reflexive Nutzung keine Skalierung, kein Muskelgedächtnis.

Einen definierten Anteil der Zeit reflektiert gestalten → „AM" KI-Workflow arbeiten. Entscheidungen mit Tragweite, neuartige Situationen, strategische Weichenstellungen, Momente, in denen der KI-Output zur Entscheidungsgrundlage für weitere Prozessschritte werden soll. Hier muss System 2 aktiv sein. Hier ist menschliche Urteilskraft entscheidend. Hier gehören Fragen hin wie: Stimmt das? Fehlt etwas? Was würde ich ohne KI anders einschätzen? Welche Perspektive hat die KI systematisch nicht berücksichtigt?

Die entscheidende Metakompetenz liegt aber weder im einen noch im anderen Modus. Sie liegt in der Fähigkeit, in Echtzeit zu erkennen, in welchem Modus man gerade ist. Und ob es der richtige ist. Kahneman nennt das Metakognition: Denken über das eigene Denken. Wissen, wann der Automatik-Modus angemessen ist und wann er problematisch wird.

Shaw und Nave zeigen empirisch: Ohne bewusste Gegensteuerung ist Cognitive Surrender der Default. Der optimale Modus ist ein schmaler Grat. Er stellt sich nicht von allein ein. Er muss aktiv gestaltet und beschritten werden. Und das sowohl individuell und organisational.

Was das für Führung bedeutet

Wie lässt sich das erreichen? Die Forschungslage ist inzwischen klar genug, um drei konkrete Hebel zu benennen:

Modus-Bewusstsein als Führungskompetenz. Führungskräfte brauchen sowohl die Fähigkeit, den Gang zu wechseln, als auch zu erkennen, wann. Die Metakognitions-Forschung zeigt, dass diese Fähigkeit als Bremse gegen automatische Entscheidungsmuster wirkt.⁸ Konkret heißt das: Vor Entscheidungen mit Tragweite die Frage stellen „Bin ich gerade im IN-Modus oder im AM-Modus? Und ist das hier der richtige Modus?" Das klingt simpel. Aber es setzt voraus, dass man überhaupt versteht, wie KI auf die eigenen kognitiven Prozesse wirkt. Genau dieses Verständnis fehlt in den meisten KI-Trainings. Es wird Anwendung trainiert, aber nicht Wirkung.

Entscheidungsarchitektur gestalten. Individuelle Willenskraft reicht nicht. Das zeigen Shaw & Nave empirisch. Cognitive Surrender passiert auch bei motivierten, aufmerksamen Menschen. Es braucht strukturelle Verankerung wie metacognitive Prompts an definierten Stellen im Entscheidungsprozess. Fragen, die zur Überprüfung der eigenen Annahmen zwingen.⁹ Wir nennen das Dissens by Design. Als Qualitätssicherung an den Stellen, wo Fehlerkosten hoch sind. Und eine einfache, aber wirkungsvolle Prozessfrage sollte ebenfalls an den richtigen Stellen mitschwingen: Beginnt eine wichtige Entscheidung mit einem KI-Output oder mit einer eigenen Hypothese?

Reflexionsräume institutionalisieren. Eine Meta-Analyse in Nature Human Behaviour (2025, 53 randomisiert-kontrollierte Studien) zeigt: Bildungsinterventionen gegen kognitive Biases wirken. Aber nicht als Frontalvortrag. Wirksam sind erfahrungsbasierte, interaktive Formate mit Feedback und Wiederholung.¹⁰ Organisationen brauchen also nicht mehr Awareness-Vorträge über KI-Risiken, sie brauchen strukturierte Räume, in denen Führungskräfte Cognitive Surrender selbst erleben, reflektieren und Gegenstrategien entwickeln. Und das am besten nicht als einmaligen Workshop, sondern als wiederholte Praxis.

Die nächste Investition ist menschlich

Reflexiv ist nicht falsch. Reflektiert ist nicht immer richtig. Wir sind überzeugt davon, dass die Zukunft denen gehört, die verstanden haben, dass souveräne KI-Nutzung kein Zustand ist, den man einmal erreicht. Die verstanden haben, dass es eine Praxis ist, die kontinuierlich gestaltet werden muss. Sowohl als Führungskompetenz, als Entscheidungsarchitektur und als organisationale Gewohnheit.

Die nächste entscheidende Investition für Organisationen ist nicht technologisch. Sie ist menschlich. Sie muss es sein. Investition in Urteilskraft und in Metakognition. Und in die Fähigkeit, bewusst zwischen den Modi zu wechseln. Erfolgreiche Organisationen werden aus Menschen bestehen, die wissen, wann der Moment gekommen ist, vom Autopiloten die Hände ans Steuer zu nehmen.

Genau hier setzt unser Training „Führung unter KI-Bedingungen" an: ein intensiver Trainingstag für Führungskräfte, die verstehen wollen, wie KI auf Entscheidungen, Verantwortung und Teamdynamiken wirkt — und die souveräne Praxis entwickeln wollen, beides zusammenzudenken: Anwendung und Wirkung. Nächster Termin: 30. März 2026, online.

Weitere Informationen zu unseren AI-Enabling Leadership Journeys - und auch weiteren Angeboten - finden Sie hier. Unser Team für das AI-Enabling steht Ihnen gerne für Auskünfte zur Seite. Schreiben Sie uns.

Fußnoten

¹ McAfee, A. (2023/2024). „The Economic Impact of Generative AI", Link; siehe auch: Beth Stackpole (2024) „The impact of generative AI as a general-purpose technology”, MIT Sloan School, Link.

² Kahneman, D. (2011). Thinking, Fast and Slow. Farrar, Straus and Giroux.

³ Shaw, S. D. & Nave, G. (2026). „Thinking — Fast, Slow, and Artificial: How AI is Reshaping Human Reasoning and the Rise of Cognitive Surrender." Wharton School Working Paper. Link

⁴ Quellen: „The Boss Has a Message: Use AI or You're Fired" (Wall Street Journal), Link; „Tech Firms Aren't Just Encouraging Their Workers to Use AI. They're Enforcing It." (Wall Street Journal), Link; „Accenture macht KI-Nutzung zur Bedingung für Beförderungen" (Golem), Link; „KI-Pflicht bei Google" (Business Insider), Link.

⁵ Section/HR Dive (2025). „1 in 6 workers pretend to use AI amid workplace pressures." Link

⁶ Gerlich, M. (2025). „AI Tools in Society: Impacts on Cognitive Offloading and the Future of Critical Thinking." Societies, 15(1), 6. Link

⁷ CHI '25 (2025). „The Impact of Generative AI on Critical Thinking: Self-Reported Reductions in Cognitive Effort and Confidence Effects From a Survey of Knowledge Workers." Proceedings of CHI 2025. Link

⁸ Bastian, B. L. & Zucchella, A. (2022). „Exploring Metacognition: The Key to Exceptional Leadership”, referenziert in: British Army Centre for Army Leadership, „Leadership Insight No. 48: Exploring Metacognition." Link

⁹ Russo, C. M. (2026). „Mitigating Decision Making Biases through Metacognitive Intervention." Link

¹⁰ Nature Human Behaviour (2025). „Systematic review and meta-analysis of educational approaches to reduce cognitive biases among students." Link

Stay in touch

André Cramer

AI & Leadership Enablement |Responsible AI & Digitale Verantwortung| Strategic Communication|Thought Leadership zu ‘Tech meets Society’

Mehr als 25 Jahre Erfahrung im Tech-, Telco & Internet-Sektor: von Start-ups bis Großkonzernen, von Europa bis ins Silicon Valley, von Product Building bis C-Level-Beratung

Innovation Foresight, Strategy & Execution Consulting u.a. bei Deutsche Telekom, Yahoo! Inc., Detecon, futurest

Mehrjährige Leadership-Erfahrung von Linien- und Projektteams

enge Zusammenarbeit mit C-Level & Direct Reports im Vorstandsstab Technology & Innovation der Deutschen Telekom

Human-Centered Technology | Co-Founder & Co-Lead einer konzernweiten Community mit mehreren hundert Mitgliedern | Fokus: Menschenbild, Verantwortung, partizipative Befähigung

ehem. Mitglied des AI Competence Centers der Deutschen Telekom | Schnittstelle zwischen Vorstandsstab, Technologie, Kommunikation & Responsible AI / AI-Governance

Langjährige strategische Kommunikations- & Enablement-Expertise | Übersetzung komplexer Tech- & KI-Themen in Führung, Entscheidungsfähigkeit & Wirkung

Host des #DRANBLEIBEN Newsletters & Podcasts und Co-Host des Code & Konsequenz Podcasts

Speaker, Coach und Trainer zu Themen wie AI, Tech Ethics, Human-centered Technology, Leadership & Culture

LinkedIn Mastodon